Escribe: Valeria Reyes (*)

En el 2020, la red social Twitter fue blanco de delicadas acusaciones debido al funcionamiento de la herramienta de previsualización de imágenes en la página de inicio de cada usuario. Ante la imposibilidad de incrustar una imagen completa en la página de inicio, la herramienta, que opera a través de un algoritmo, seleccionaba una porción de cada imagen para permitir a los usuarios previsualizar su contenido. El algoritmo en cuestión estaba diseñado para hacer esta selección en función a los rasgos más importantes de cada imagen ¿Qué sucedió, entonces? Pues, un grupo de usuarios notó que, cuando las imágenes consistían en fotografías de personas, la previsualización siempre favorecía a personas blancas antes que a personas de piel más oscura. Ante la incredulidad de que algo así pudiera darse, miles de usuarios se volcaron a la red social para comprobar por sus propios medios cómo funcionaba el algoritmo. Para Twitter no quedó más que disculparse por tener un “algoritmo racista”.

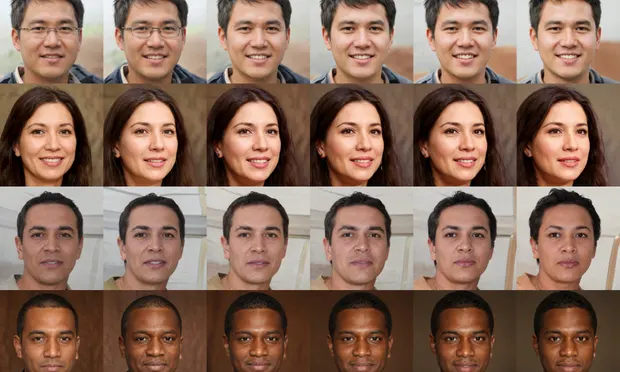

Pero la historia no termina ahí. Como medida posterior, Twitter lanzó un premio convocando a investigadores que pudieran identificar si, pese a las pruebas desarrolladas antes de su lanzamiento, el algoritmo había incorporado un sesgo racial y cómo esto había ocurrido. Un estudiante suizo utilizó la inteligencia artificial para crear rostros con características físicas variadas y así someter al algoritmo de Twitter a prueba. Su sistema le permitió incluso crear rostros prácticamente idénticos, pero con tonalidades de piel, edades o géneros distintos. El resultado de la investigación fue que el algoritmo prefería los rostros más jóvenes, delgados y con pieles más claras al recortar las imágenes para permitir su previsualización. Aparentemente, el algoritmo había aprendido qué rasgos resultaban “más atractivos” socialmente.

El caso de Twitter sirve como excusa para adentrarnos en preguntas más complejas sobre la relación que se sigue desarrollando entre las nuevas tecnologías y los derechos humanos. El recurso de las herramientas que brinda la tecnología puede significar acortar las brechas de acceso a derechos humanos que hoy en día siguen actuando como privilegios de algunos pocos. Como bien ha destacado el Comité Asesor del Consejo de Derechos Humanos de las Naciones Unidas, las nuevas tecnologías contribuyen a empoderar a las personas y garantizar sus derechos y libertades, y brindan oportunidades para determinados grupos en situación de vulnerabilidad[1]. Sin embargo, es importante mantener las alertas activadas en lo que respecta a los riesgos que estas herramientas entrañan, particularmente cuando se utilizan para tomar decisiones que más adelante pueden tener ante la sociedad un tinte de objetividad y neutralidad que lleve a justificar acciones discriminatorias.

En concreto, la discriminación racial ha sido definida como toda distinción, exclusión, restricción o preferencia basada en motivos de raza, color, linaje u origen nacional o étnico que tenga por resultado anular o menoscabar el goce de derechos en cualquier esfera de la vida de una persona[2]. Los tres elementos clave que ofrece esta definición – acto, motivo y resultado – pueden tocarse estrechamente con el modo de funcionamiento de herramientas que utilizan inteligencia artificial.

«La tecnología, finalmente, es diseñada y utilizada por personas humanas, de manera que tiene la capacidad – y altísima probabilidad – de reproducir las estructuras de discriminación que ya existen en la sociedad.»

Un estudio del 2018 promovido por el Consejo de Europa señala que, en la medida en que la inteligencia artificial supone que “las computadoras encuentren correlaciones a partir de conjuntos de datos”[3] existen muchas maneras por las cuales estos procesos podrían resultar en decisiones discriminatorias. Por ejemplo, el sistema podría estar indirectamente diseñado para encontrar correlaciones que generen un impacto diferenciado sobre ciertos grupos, o para “aprender” de información que ya contiene sesgos raciales o étnicos. Lo primero sucedería, por ejemplo, si se ingresan al sistema categorías de clasificación de información que son aparentemente neutrales pero que, en su aplicación a la realidad, favorecen a una clase o grupo en desmedro de otra. Lo segundo ocurriría si el sistema es inducido a tomar decisiones en función a información que ha sido históricamente compilada siguiendo patrones racistas, como, por ejemplo, determinados registros de criminalidad que se han enfocado de forma arbitraria en ciertas poblaciones por sus características raciales u origen nacional.

En un informe reciente, la Relatora Especial sobre las formas contemporáneas de racismo, discriminación racial, xenofobia, y formas conexas de intolerancia destacó cómo esta dinámica se ha materializado en la realidad, revelando problemas estructurales de discriminación racial en distintas prácticas normalizadas en muchos Estados del mundo[4]. Por ejemplo, el derecho al trabajo se ha visto afectado en países de América del Norte y Europa en donde se han utilizado algoritmos para seleccionar a candidatos a partir de los datos de otros trabajadores considerados “competentes”, pero que constituían de por sí una muestra sesgada y excluyente de determinados grupos raciales. De igual manera, en países como Argentina y Colombia se ha recurrido a la inteligencia artificial para acelerar la adopción de sentencias en casos de poca complejidad; sin embargo, la forma en que se diseñan las herramientas necesarias para tal fin no permite medir con precisión el impacto que estas generan en ciertas minorías, lo que incrementa el riesgo de que se refuercen disparidades raciales en los sistemas de justicia.

El creciente recurso a las nuevas tecnologías para agilizar procesos y mejorar servicios de diversa índole es una realidad, por lo que tener conciencia de los riesgos que esto genera en la lucha contra la discriminación racial y adoptar acciones preventivas y correctivas es un deber prioritario para los Estados y las empresas. Pensar en una solución que promueva un enfoque regulatorio de las nuevas tecnologías parecería ineficiente pues estas no conforman un grupo homogéneo sobre el cual se pueda aplicar un set de normas específicas. No obstante, no debe descuidarse la importancia de fortalecer los marcos legales antidiscriminatorios y las normas de protección de datos personales, así como de integrar a las empresas en el esfuerzo por la implementación de buenas prácticas basadas en un enfoque de derechos.

La tecnología, finalmente, es diseñada y utilizada por personas humanas, de manera que tiene la capacidad – y altísima probabilidad – de reproducir las estructuras de discriminación que ya existen en la sociedad. Acoger esta perspectiva es clave para impulsar su uso.

(*) Coordinadora del Área Académica y de Investigaciones del IDEHPUCP.

[1] Informe del Comité Asesor del Consejo de Derechos Humanos. Impactos, oportunidades y retos que pueden entrañar las tecnologías digitales nuevas y emergentes en relación con la promoción y la protección de los derechos humanos. A/HRC/47/52. 19 de mayo de 2021. Párr. 10.

[2] Véase: Artículo 1 de la Convención Internacional sobre la Eliminación de todas las Formas de Discriminación Racial

[3] BORGESIUS, Frederik. Discrimination, Artificial Intelligence, and Algorithmic. Council of Europe. 2018. P. 15.

[4] Informe de la Relatora Especial sobre las formas contemporáneas de racismo, discriminación racial, xenofobia y formas conexas de intolerancia. A/HRC/44/57. 18 de junio de 2020.